先选稳定VPS(或本地GPU),装系统与Docker与docker‑compose,部署开源翻译引擎或接入云翻译API,配置Nginx反向代理并申请SSL证书,设置API密钥、访问限流和日志备份,必要时装GPU驱动与显存管理,最后在易翻译客户端填入自建地址并验证证书与权限,并做压测与回滚方案和监控实时

先说最核心的:自建服务器是怎么“通向易翻译”的

把这一过程想象成盖房子:VPS是地基,翻译引擎是房子的“心脏”,反向代理和证书是门窗与锁,API密钥是门禁卡,客户端(比如易翻译)就是来访的人。要能让易翻译成功使用你的自建服务器,你需要让“门”能被它访问(域名、端口、HTTPS),确保“房子”不会崩溃(性能、监控、限流),并且不会变成“无人管理的危险建筑”(安全、备份、更新)。下面我按步骤把这件事拆开说明,尽量从为什么要这么做讲起,再教具体怎么做。

准备工作(你的清单)

- 账号和资源:一个稳定的VPS(推荐有固定IP和良好网络),若要跑本地大模型则需GPU实例或本地带GPU的机器。

- 域名:最好有域名,便于申请TLS证书和客户端配置。

- 软件:Ubuntu/Debian/CentOS、Docker、docker‑compose(或Podman)、Nginx(反向代理)、certbot(或ACME客户端)。

- 翻译引擎选择:云API(如通用翻译服务)、或开源引擎(Marian、OpenNMT、Fairseq、Argos Translate、M2M-100/transformers等)。

- 运维工具:防火墙(ufw/iptables)、日志工具(ELK/简单文件日志)、监控(Prometheus/Grafana或基本脚本)。

为什么要用Docker和反向代理?

Docker把每个组件隔离开来,便于部署、回滚和版本管理;Nginx反向代理可以统一做HTTPS、负载均衡和限流。如果不想太复杂,Docker Compose 能把多个容器一键启动;实在想省事也可以直接用云翻译API,这样服务器只做反向代理和鉴权。

步骤一:选VPS与硬件建议

- 轻量用途(仅转发或接云API):1 vCPU、1–2GB内存、几十GB磁盘即可。

- 中等并发(CPU推理、小模型):4–8 vCPU,8–16GB内存,SSD。

- 高性能或本地大模型:NVIDIA GPU(如T4/RTX系列),至少16–32GB显存视模型而定,Linux+驱动+CUDA。

如果你只是想接入云翻译(把调用代理到第三方),VPS成本最低;若想离线推理或避开第三方,GPU就是必备的“燃料”。

步骤二:系统与基础软件安装(示例以Ubuntu为主)

安装Docker、docker‑compose和Nginx基本命令像是日常操作,这里不逐行贴所有命令,但注意几点:要把服务器的时间同步(ntp),打开必要端口(80/443)、关闭不需要的服务、并为SSH做密钥登录。

推荐的目录结构与服务划分(Docker Compose)

| 服务 | 用途 | 端口示例 |

| nginx | 反向代理、TLS | 80/443 |

| translator | 翻译引擎(容器) | 8000(内部) |

| redis | 限流/缓存 | 6379(内部) |

| postgres/logs | 日志与审计 | 5432(内部) |

步骤三:选择翻译引擎(关键决策)

这一步很决定成本、延迟和质量。大体有三种路径:

- 完全代理云翻译API:最省力,质量和稳定性由第三方保证,但有费用与隐私顾虑。

- 部署轻量开源模型(CPU可跑):如Argos Translate或小型Marian/ONNX模型,延迟中等,适合低并发。

- 部署大型神经模型(GPU):使用transformers、M2M-100或自训练模型,质量高但成本与运维复杂。

选择时考虑:语言对(中英/多语)、并发量、预算、隐私要求。

开源引擎实例说明

- Marian:高性能的NMT框架,适合生产环境,支持GPU加速。

- OpenNMT:灵活,支持多种部署方式。

- transformers(Hugging Face):大量预训模型(需要更多显存),便于快速试验。

- Argos Translate:轻量,适合离线桌面级使用。

步骤四:部署与反向代理(实战角度)

基本思路:翻译服务只在内部端口(如8000)监听,Nginx对外暴露HTTPS并反代到内部翻译服务,同时负责证书续期、访问控制与限流。

一个简化的Nginx反向代理要点

- 配置HTTPS(使用certbot申请Let’s Encrypt证书)

- 启用HTTP/2以降低延迟

- 设置client_max_body_size,适配大文本或批量请求

- 配置basic auth或通过IP/Token做二次鉴权(建议Token+TLS)

步骤五:鉴权、限流与日志

别把接口直接暴露给全世界。常见做法:

- API Key:为每个客户端或每个场景发一个秘钥,服务器校验后再调用翻译引擎。

- 限流:用redis做计数(令牌桶/滑动窗口),防止滥用。

- 日志与审计:保存请求日志与响应状态,便于排查和计费(如需)。

性能优化与监控

实践中你会发现翻译的延迟很敏感。常用优化:

- 批量推理:把多个小请求合并为一个大批次(对模型友好)。

- 混合精度(FP16):GPU上可显著加速并减少显存占用。

- 模型量化/ONNX:在CPU上优化推理速度。

- 水平扩展:在负载高时,多实例并用负载均衡。

监控方面建议至少有:CPU/GPU使用率、内存、请求成功率、平均延迟、错误率。Prometheus+Grafana是常见组合,若觉得太重,也可用简单的脚本与邮件告警。

运维与备份

- 定期做配置与模型的备份(S3或其他对象存储)。

- 部署日志轮转,避免磁盘被日志填满。

- 设计回滚方案:每次更新前保留旧镜像和配置,出现问题可快速回退。

- 安全更新:及时打系统和容器镜像的安全补丁。

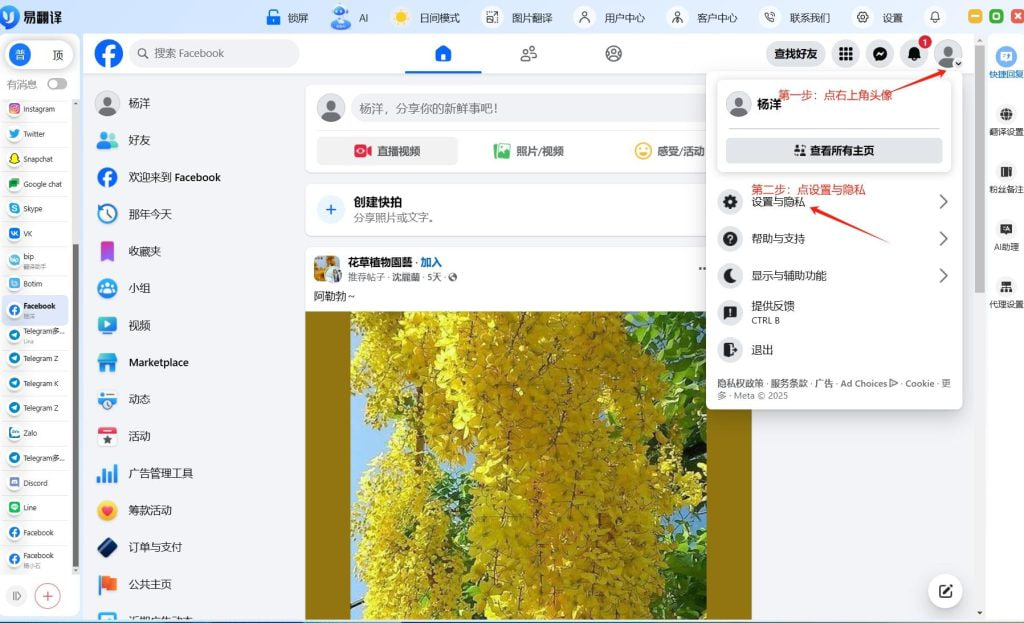

如何把地址填到易翻译客户端(实操)

通常易翻译类客户端会在“服务器配置”或“自定义服务”里允许你填写API地址与Key。具体步骤:

- 在Nginx上把API暴露为https://translate.example.com/api/v1/translate(示例)

- 为客户端生成一个API Key,并写进头部或请求体(按你后端实现)

- 在易翻译中填写URL与Key,选择正确的请求方法(GET/POST)和参数格式(JSON字段名)

- 做一次简单测试:短句翻译、长句、并发测试、错误码处理

常见问题与坑

- 证书不被信任:检查域名是否和证书匹配,客户端是否允许自签证书。

- 跨域/CORS问题:若易翻译是桌面或手机客户端一般没CORS,但web环境要配置允许来源。

- 模型显存不够:降低batch,使用CPU模式或换更小模型。

- 偶发超时:检查Nginx超时、后端超时、网络延迟,适当增加超时时间或优化模型响应。

小结与实践建议(边做边调)

先从最小可用方案开始:用小VPS + Docker + 云翻译或轻量开源模型,搭好HTTPS和API Key,把易翻译指向它。跑一段时间观察访问模式,再决定是否需要GPU、更多实例或更复杂的限流策略。别一开始就追求“完美”,实战中你会一步步发现瓶颈并调整。

如果你愿意,我可以把一个简化的 docker‑compose 示例、基本的Nginx配置片段和一个简单的API鉴权逻辑写出来,方便你直接复制粘贴做实验,或者根据你当前的VPS与预算帮你选出最合适的方案。想要哪个先给我说一声,我这边接着写。