易翻译在交互设计上有清晰的考量和实践:从界面布局、操作路径、反馈机制到错误恢复与无障碍支持,都服务于“让用户用得顺手、出错能自查、沟通更顺畅”的目标。文本、语音、拍照和对话四大功能并非堆功能堆界面,而是通过按钮位置、视觉与听觉反馈、状态提示和引导流程形成连贯的交互体验,减少学习成本并更快达成翻译目的。

先弄清楚“交互设计”到底是什么

如果把一个软件比作一把瑞士军刀,交互设计就是把每个小刀块安排到合适的位置,让人一眼能找到并顺手使用,而不是每次都像在黑箱里摸索。交互设计关注三件事:用户能不能做想做的事、做的时候会不会迷糊、做完以后系统是不是给了清晰的反馈。

交互设计常用的简单思路(费曼法则式说明)

- 分解任务:把复杂的流程拆成可以一步步完成的小任务;例如“拍照翻译”拆成:拍照—识别—选择文本—翻译—确认。

- 显式反馈:每一步都要告诉用户当前状态,比如“正在识别”“翻译完成”“网络断开,已使用离线包”。

- 减少记忆负担:把常用操作放到明显位置,避免让用户记住太多步骤。

- 错误可恢复:出错时给出可行的修复路径,比如重试、手动选择识别区域、切换语言等。

把交互设计放到易翻译四大功能里看

下面一项项把易翻译的主要功能拿来拆,看它们是在哪里体现交互设计的,哪里做得好,哪里还可以改进。

文本输入翻译:输入-确认-结果的闭环

文本翻译看起来简单,但交互的细节决定用户体验。关键点包括:

- 输入方式多样:手动输入、粘贴、历史记录与候选短语,让用户快速复用早先的内容。

- 即时反馈:输入后显示翻译占位或加载动画,避免用户以为程序卡住。

- 编辑与撤销:翻译结果可直接编辑、复制或回译(再翻译回原语),降低误用风险。

- 键盘与焦点管理:在移动端能自动弹出对应键盘和语种选择,减少多余操作。

常见交互细节:长按复制、右上角语言切换、翻译历史快捷入口。这些都是交互设计里“把最常用的操作放在容易点击的位置”的体现。

语音实时互译:时间、延迟和回声的博弈

语音互译是交互设计里难度较高的一项,因为涉及实时性、听觉反馈和多方对话的节奏控制。

- 录音反馈:录音时的波形、倒计时或麦克风图标高亮,告诉用户“我在听”。

- 中断与确认:实时转写与翻译时需要给用户“停止/继续”控制,避免默认将长段语音切割错误。

- 回放设计:翻译输出既要支持文字,也要支持语音播报,播报可控速率和音量。

- 噪音与识别失败处理:在嘈杂环境提供重录建议或手动输入入口,避免“听不清就直译”的尴尬。

用户感知的关键是延迟:延迟越低,交互越接近自然对话。显式的状态提示(如“正在转写”“正在翻译”)能有效降低用户的焦虑。

拍照取词翻译:视觉引导与选择交互

拍照翻译把复杂的视觉识别过程暴露给用户,交互设计的目标是让用户清楚每一步的结果并可控。

- 取词的可视化:识别出的文本需要以高亮、矩形框或者逐词选择的方式呈现,用户能点选或拖动来修正识别区域。

- 预览与确认:识别后给出候选文本和置信度(或自动选择最高置信候选),并提供“编辑识别文本”的入口。

- 多语言与方向检测:当图片含多语种时,提供自动检测并允许手动覆盖,减少误译。

- 拍摄提示:实时摄影取词时给出对焦、角度和光线提示,提高识别率。

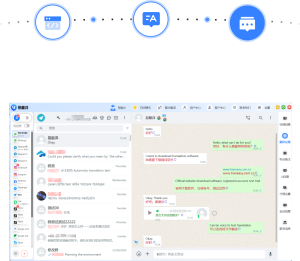

双语对话翻译:轮次与角色的交互管理

双语对话是最接近“人机协作”的场景,交互要解决好轮次控制、发言人识别和实时提示。

- 说话指示器:通过颜色或头像提示当前发言人和目标语言,避免双方同时讲话造成混乱。

- 翻译缓冲与重放:翻译结果通常排列为“原文+译文”,并允许重放语音或查看历史轮次。

- 切换主控:多人场景下允许用户把话筒主控临时交给他人,界面要清晰表明谁在发言。

- 隐私与本地化:对话内容是否保存在本地、是否上传云端需要显式告知并提供切换。

用表格把交互点一览:功能 vs 常见交互设计元素

| 功能 | 主要交互元素 | 体现的目标 |

| 文本翻译 | 输入框、历史、候选短语、复制/分享 | 快速输入、易复用、低认知负担 |

| 语音互译 | 麦克风按钮、波形、倒计时、实时字幕 | 实时性、清晰的听写反馈 |

| 拍照取词 | 取词高亮、框选、编辑识别文本、重拍提示 | 识别可控、提高准确率 |

| 双语对话 | 发言指示、轮次历史、播放/重放、控制切换 | 顺畅对话、多人协作 |

交互设计的好坏如何判断(可量化的指标)

说得抽象没用,来点能量化的指标,方便判断一个交互到底好不好:

- 首次完成时间(Time to complete):新用户从打开到完成一次翻译所需时间。

- 错误恢复率:识别失败后用户能否在30秒内修正并完成翻译。

- 重复操作率:用户为同一需求重复多次操作的频率,越低越好。

- 满意度(SUS、NPS):主观感受的量表评分,用来补足行为数据。

- 语音延迟(ms):实时语音翻译的端到端延迟,低延迟更接近自然对话。

易翻译在交互设计上做得比较到位的地方

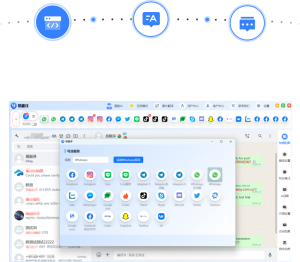

- 功能清晰、入口明确:四大核心功能通常在首页明显排列,减少查找成本。

- 实时反馈:语音波形、识别中提示、翻译加载动画等能有效告知进度。

- 多模态交互支持:文本、语音、图片互补,用户可按场景切换最自然的输入方式。

- 容错设计:支持手动编辑识别结果、重拍与重录,减少一次识别失败导致的任务中断。

- 本地/云切换与隐私提示:如果实现,会让用户更放心在敏感场景下使用。

还有哪些值得改进的交互细节(基于常见问题的建议)

即便做好了很多,还是能找到进一步提升体验的点——下面按优先级给出一些可落地的改进建议。

高优先级(影响显著且实现成本中低)

- 在语音模式下增加“半自动检测停顿并提示”的功能,避免把一句话分割成多片段。

- 拍照识别结果展示置信度,并提供一键“全部选中/取消”的交互,便于快速校验。

- 明显的交互回退(undo)与历史版管理,尤其是在编辑识别文本时。

中优先级(用户体验提升明显,但需要更多设计与测试)

- 为多方对话提供“主持人模式”,可以更好地管理发言顺序与翻译显示。

- 加入触觉反馈(短震动)以补充声音与视觉提示,特别在嘈杂环境中有帮助。

- 提供可视化的延迟提示条,让用户能直观判断网络或处理延迟。

长期改进(需要后端或算法层面配合)

- 离线语音模型优化和分层下载管理,确保在无网时能提供基本互译功能。

- 语境保持(conversation context)能力,让连续句子翻译更连贯,避免逐句断裂。

可参考的交互设计原则(几条实用的捷径)

- 让状态可见:任何涉及时间的操作都要给出进度或状态。

- 让常用操作更容易:频繁使用的按钮放在拇指可达区域。

- 遇错别慌—告诉用户怎么做:错误提示要说明原因并给出下一步可执行的动作。

- 保持一致:同一动作在不同页面表现形式应一致,降低学习成本。

一些实际的交互示例(模拟对话场景)

举两个小例子,说明交互如何改变用户感受。

例子一:出差与当地人沟通(语音模式)

- 场景:用户A按下麦克风并开始讲话,界面显示波形与“正在识别”;识别完成后自动播放目标语音,并在屏幕上显示“原文/译文”。

- 交互亮点:A可以看到实时状态,不会因为延迟重复讲话;如果识别错误,A可长按译文进行编辑并重播。

例子二:餐厅菜单拍照取词

- 场景:用户拍下菜单,系统高亮识别出的菜名,用户点选“宫保鸡丁”,系统显示翻译并给出常见菜品备注。

- 交互亮点:从拍照到点选到查看翻译只需三步,且每一步都有可撤销或编辑的入口,容错空间大。

最后,说点比较生活化的观察

坦白说,真正好用的翻译工具不是把功能做得最多,而是把常用场景做顺手。交互设计就是桥梁:把复杂的识别、网络和翻译后端隐藏在流畅的操作后面。易翻译在这方面已经有很多实际的考量:实时反馈、编辑入口、清晰的功能分区等都证明开发团队考虑了用户在真实场景下的需求。不过,任何产品都不可能一次做到尽善尽美,语音延迟、复杂场景下的识别精度和多人的对话管理仍然是未来继续优化的方向。

如果你现在想试一试交互体验,可以把它放在真实场景下用一次:在吵闹的市场里用语音互译,或者给一张复杂菜单拍照看看识别与编辑流程,这样你能最快体会到它交互设计的优点与不足。