易翻译在“实景”场景下能做很多事情:通过拍照取词和实时语音互译识别环境中的文字与语音并给出翻译与朗读,但如果你想要像电影里那种镜头中直接覆盖字幕的无缝AR实时呈现,那并不是每个版本都原生支持,具体能否实现取决于设备权限、系统能力、网络状况和安装的功能模块。

先把“实景语”这件事说清楚

说到“实景语”,我们先别急着下结论——这个词可以有好几层意思。简单来说,它大概包含两类用户期待:

- 视觉实景翻译:相机对准一个场景(比如街牌、菜单、路标),识别文字并给出翻译,可能是静态(拍照后翻译)或接近实时(相机预览时识别并覆盖)。

- 语音实景翻译:在一个真实环境中(例如街头或餐厅),实时识别并翻译周围人的语音,直接输出目标语言的声音或文字。

这两个维度经常被合并成“实景语”,但实现难度、用户期待与技术路径并不完全相同。所以在判断一个产品是否“支持实景语”时,先确定你想要哪一种体验。

易翻译能不能算是真正的“实景语”工具?

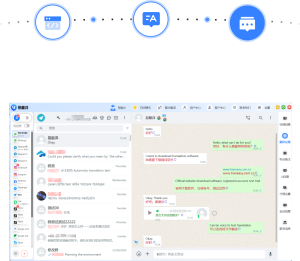

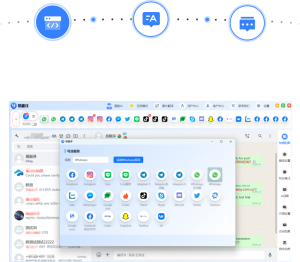

按你上面给出的产品描述,易翻译已具备四大核心功能:文本输入、语音实时互译、拍照取词、双语对话翻译。这说明它具备实现多数实景场景的基础模块:

- 拍照取词:可以把场景文字转为可翻译的文本(OCR),适合菜单、指示牌、说明书等。

- 实时语音互译:能在会话或对话场景中把一句话即时识别并翻译成另一种语言并朗读。

- 双语对话翻译:便于双方轮流说话并得到即时翻译,适合面对面交流或电话场景。

也就是说,易翻译已经覆盖了“实景语”常见的两类需求:视觉与语音识别与翻译。但要不要称其为“完全集成的AR实景字幕”就另说了——那依赖于是否支持镜头预览中的实时覆盖(AR HUD)以及延迟、稳定性与平台权限。

关键词:拍照取词 ≠ 无缝AR实时覆盖

很多人把“拍照取词”和“实景实时字幕”混为一谈。拍照取词通常是:你按下拍照或上传图片,软件在图片上做OCR并翻译,速度可以很快,但并非“镜头中直接显示”的那种体验。真正的AR实时覆盖则需要在相机预览流中连续做OCR/翻译/渲染,这对性能、延迟、权限和平台API(比如iOS的ARKit或Android的ARCore)要求更高。

从技术角度:易翻译如何做到实景类功能的?(用费曼式把复杂变简单)

把它想成三个小工序排成的流水线:

- 看(视觉)或听(语音)——感知层:相机拍下图片或麦克风录下声音,软件把它转成文字(OCR或ASR)。

- 懂——翻译引擎:把识别出来的文字通过机器翻译模型(NMT)转换成目标语言。

- 说或显示——呈现层:把翻译结果以文本、语音或覆盖在画面上的方式呈现给用户。

想象你在街上,手机像眼睛一样看见一块菜单(OCR),把中文变成英文(NMT),然后把英文以文字或语音反馈给你(呈现)。如果把这一系列在相机预览中做到每秒多次更新,那你就离“实时AR字幕”更近了,但这需要更多处理能力和更复杂的工程。

功能清单与实际表现(表格化看得更清楚)

| 功能 | 易翻译(基于描述) | 实际限制/备注 |

| 文本输入翻译 | 支持 | 准确率高,适合短句、文件片段 |

| 拍照取词(OCR) | 支持 | 适用于清晰图像;复杂字体、弯曲表面或低光条件时精度下降 |

| 实时语音互译(ASR+NMT) | 支持 | 对普通话、英语等主流语言效果较好;方言、噪声环境是难点 |

| 双语对话翻译 | 支持 | 适合一对一沟通,若多人并发说话会影响识别准确性 |

| AR镜头覆盖式实时字幕 | 部分版本/设备支持或通过SDK实现 | 并非必然支持,依赖平台API、算力与软件实现 |

| 离线翻译 | 视版本与离线包而定 | 离线包通常体积大,覆盖语言与模型能力有限 |

在现实中你会遇到的局限(别被场景美图骗了)

- 光照与角度:OCR对光线和拍照角度敏感,逆光、反光或弯曲表面会影响识别。

- 字体与排版:手写、花体或非常密集的排版会降低正确率。

- 口音与噪声:语音识别在嘈杂环境或方言下误识率更高。

- 延迟问题:实时预览的翻译需要低延迟网络和强劲算力,若用云端服务则受网络波动影响。

- 隐私与权限:实景翻译常需要相机与麦克风权限,数据是否上云处理与保留需看隐私政策。

如何把易翻译的“实景体验”提升到最好(实操指南)

下面这些小招很实用,按步骤来,效果会明显好很多。

- 拍照取词:

- 尽量保证光线充足、相机对准且稳定;

- 如果是菜单或书页,平放并拍正面,避免倾斜;

- 选择高分辨率模式(如果有),方便OCR提取小字。

- 实时语音互译:

- 在较安静环境或靠近说话人使用;

- 尽量让说话人面向手机麦克风;

- 必要时使用耳机麦克风或外接麦克风改善拾音。

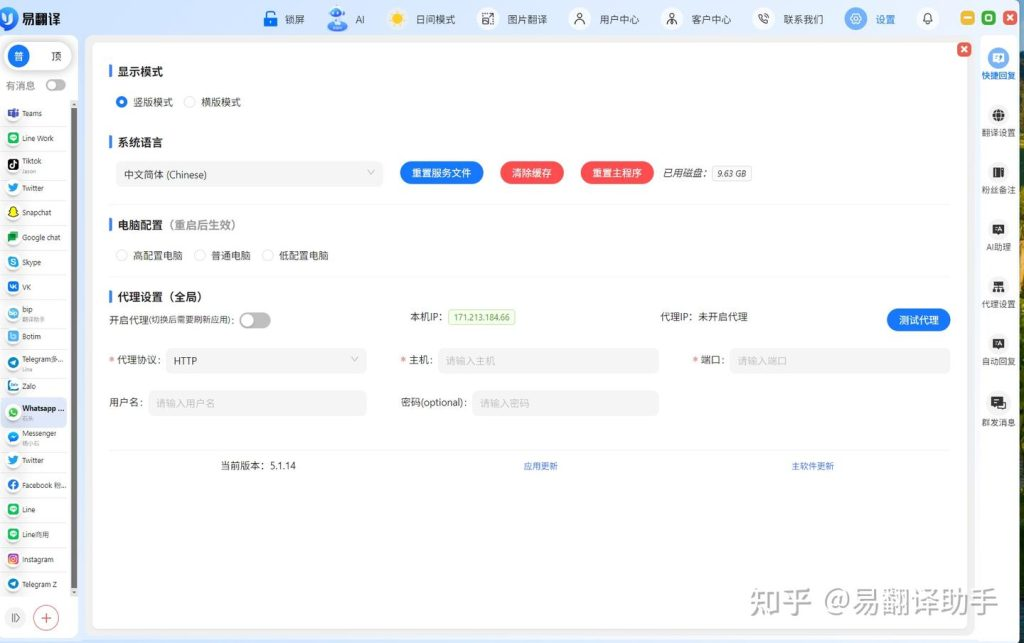

- 设置与权限:

- 授予相机和麦克风权限;

- 如果支持离线包,下载目标语言的离线包以备无网络时使用;

- 在App内选择正确的源语言或开启自动检测以减少识别错误。

- 常见小技巧:

- 遇到长段落先拍照后分段翻译;

- 对专有名词或地名,多尝试手动纠正源文本后再翻译;

- 如果听不清,切换到“对话模式”让双方轮流发言提高识别率。

如果你想验证“是否是原生AR实时字幕”建议这样测试

- 打开相机取词功能,观察是否仅在拍照后返回结果,还是在相机预览时就持续显示翻译。

- 在不同光照和距离下尝试,记录延迟:AR实时字幕通常会持续更新而非每次要按快门。

- 查看App设置或版本说明:若有“实时翻译/AR字幕”字样或需要额外下载的AR模块,那就是支持的迹象。

与其他主流产品的粗略对比(思考式,不讲厂商优劣)

把易翻译放在市场里看,它的功能组合(文本、拍照、语音、对话)是主流翻译类APP的常见集合。差异更多体现在实现细节:

- 有的产品把重点放在离线翻译包以保证无网络时可用;

- 有的在AR显示上做了深度优化,实现流畅的实时覆盖;

- 也有的在专业术语或行业词汇上训练了定制模型,适合商务或医学等场景。

所以“易翻译是不是最强的实景语工具”不是一个绝对答案,而是看你的重点需求:离线优先、AR优先、专业术语优先或是轻便旅行使用。

隐私与安全:实景翻译常见疑问

- 数据是否上云?很多实时翻译会把音频或图像发到服务器进行更强的识别和翻译,离线包则不会。但具体要看易翻译的隐私条款与设置。

- 录音或图片是否会被保存?多数App会提供是否保存历史记录的选项,默认行为要看权限与设置。

- 如何降低隐私风险?在处理敏感信息时优先使用离线模式或在上传前手动模糊关键信息,查看并关闭应用的云同步和语料收集选项(若有)。

常见问题(FAQ)——像朋友一样问答

问:在嘈杂环境下还能用吗?

答:可以,但准确率会下降。尽量靠近说话人或切换到对话模式并且使用耳机麦克风能显著提升效果。

问:能实时把手机镜头中的外语变成我的母语字幕吗?

答:部分版本与设备支持“实时预览式”识别并在屏幕上显示翻译,但如果你找的是无缝、毫秒级无延迟的电影级字幕体验,目前多数手机和APP都会有延迟或覆盖不稳的问题,且不同系统能力差别较大。

问:离线模式下支持多少语言?

答:通常离线包覆盖较少的主流语言,且模型体积较大。若你经常出国而网络不稳定,提前下载目标语言离线包是明智的做法。

实用示例(走心的场景演示)

- 旅行点餐:把手机对准菜单拍照取词,快速获得菜品翻译与发音,点菜更自信。

- 路标与乘车:拍照识别路名或站点信息,结合地图使用更好判断方向。

- 临时口译:对话模式下双方轮流说话,易翻译即时播报,适合短时沟通或询问方向。

- 学术阅读:长段外文可先拍照识别再分段翻译,校对专有名词后理解更准确。

小结式提示(别当总结,就是几个可立即用的建议)

- 想要“拍照取词”体验:保证清晰拍摄与正确语言选择。

- 想要“实时语音翻译”:靠近说话者并使用对话模式。

- 想要“AR字幕”体验:先确认App版本是否声称支持实时预览覆盖,再在实际场景里试验延迟与稳定性。

- 隐私敏感时:优先使用离线包或在上传前关掉自动保存。

写到这里,我忽然想起,上一次用类似功能是在海外旅行里,靠着拍照翻译菜单避过了“误点螃蟹”的尴尬——那种即时能读懂文字的感觉真的省心很多。易翻译把必要的构件都放在了工具箱里:OCR、ASR、NMT和对话逻辑,如果你需要的是实用且覆盖广的“实景”解决方案,它已经是一个不错的选择;如果你要的是电影级的AR无缝字幕,那就要看具体版本、设备和厂商对AR能力的投入了,试用和实测往往比声明更可靠。希望这些信息能让你更清楚地知道该怎么试用和检验“实景语”这个功能,免得到现场再被各种光线、方言或权限问题弄得手忙脚乱。