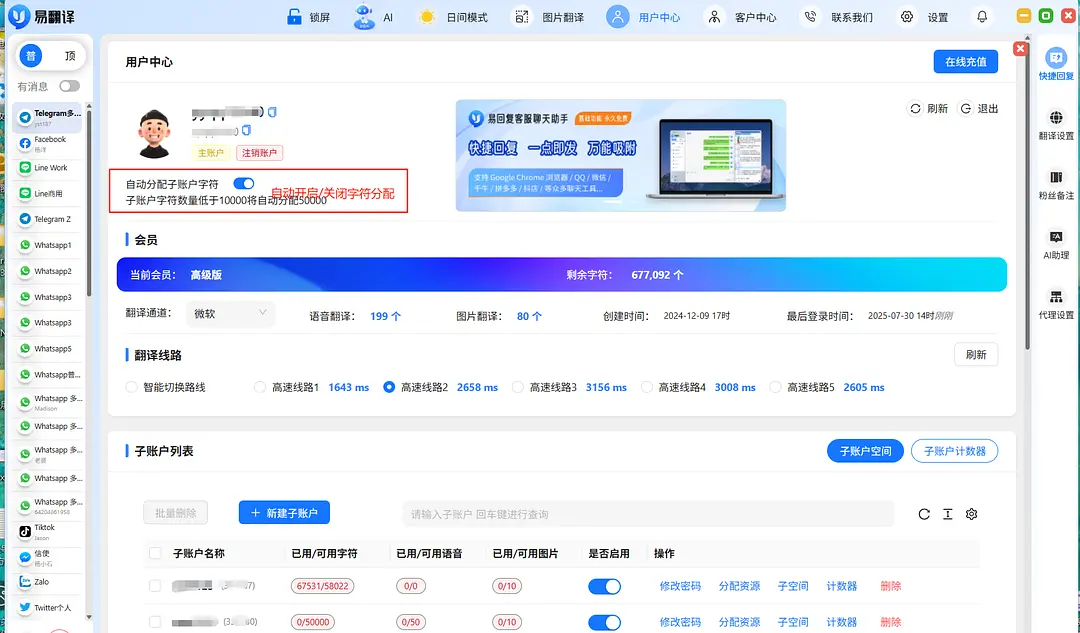

要做易翻译的竞品分析,先界定核心场景与目标用户,列出直接与间接竞品,建立功能与性能矩阵,采集定量与定性数据(留存、转化、ARPU、延迟、WER、BLEU 等),再做差距映射与优先级排序,最后形成可执行的产品/技术/运营路线图与检验假设的实验计划,包含访谈脚本、评分模板与样本表单,便于持续迭代与监控。

为什么用竞品分析?先把门槛讲清楚

说白了,竞品分析不是为了模仿,而是为了看清差距:用户会在哪些场景选择别的翻译工具?我们的弱点是哪里?能在哪些点创造独特价值?用费曼法,先把复杂问题拆成简单的子问题,然后逐个解决。

总体框架(一步步做,不要着急)

- 定义目标与边界:明确分析要回答的核心问题(例如:提升留存、降低延迟、打开出海市场、优化付费转化等)。

- 绘制竞品地图:把竞品分为直接、替代、潜在威胁三类。

- 收集证据:定量数据(应用商店、流量、指标)、定性数据(用户评论、访谈、可用性测试)、产品体验(功能试用、性能测试)。

- 对比并打分:用标准化矩阵对功能、性能、价格、UX、技术架构、安全与合规等维度评分。

- 识别机会并制定路线:根据影响力与实现难度优先排序,形成短中长期任务与实验计划。

第一步:定义目标、用户与场景

如果目标不清晰,分析就像漫无目的逛商场。先回答三问:

- 我们的核心用户是谁?(学生、出差人士、商务译员、语言学习者等)

- 关键场景是什么?(拍照取词、离线翻译、实时语音翻译、双语对话)

- 竞品分析要解决的具体问题是什么?(做出更好译文质量?降低识别延迟?提高付费转化?)

举例:若目标是“提升边境旅行用户的即时语音互译体验”,就重点考察实时语音识别(ASR)准确率、端到端延迟、离线能力、电池消耗与UI简洁性。

第二步:识别并分类竞品

把竞品按角色分清楚,便于有针对性比较。

- 直接竞品:Google Translate、Microsoft Translator、DeepL(若进展到语音/拍照)、有道翻译、腾讯翻译君等,功能重叠度高。

- 替代品:词典类(金山词霸)、学习类(扇贝、百词斩)、通用助手(微信小程序、手机自带翻译)。

- 潜在威胁:语音厂商(科大讯飞)、云服务(AWS Translate)、本地化团队、硬件厂商(耳机厂商做即时翻译)。

第三步:构建对比矩阵(核心方法)

做矩阵时,保持可量化和可复现。以下是建议维度:

- 功能维度:文本翻译、语音实时、拍照OCR、对话模式、离线包、多人会话、翻译记忆/术语库

- 性能维度:译文延迟、ASR WER(词错误率)、MT BLEU/ChrF(或人工评分)、离线模型大小

- 用户体验:界面复杂度、引导流程、支持语言数、错误提示

- 商业模型:免费/订阅/按次计费、付费功能、企业解决方案

- 技术与集成:是否有 SDK/API、跨平台支持、支持离线SDK、第三方模型依赖

- 合规与隐私:数据是否上云、隐私说明、GDPR/CCPA 合规情况

| 维度 | 要点 | 示例量表 |

| 译文质量 | BLEU、人工 5 分制评分、术语一致性 | 0-100 / 1-5 |

| 实时语音 | ASR WER、往返延迟(ms)、丢包容错 | WER%;延迟 ms |

| 拍照OCR | 识别准确率、支持语言、复杂背景鲁棒性 | 准确率% / 支持语种数 |

如何采集数据(工具和方法)

数据来源要多元,互相印证:

- 公开数据:应用商店排名与评论、公司财报、开发者博客、研究论文(例如关于MT的ACL/EMNLP论文)。

- 量化测试:搭建测试集(标准语料 + 场景语料),跑 BLEU、TER 或人工评估;录制语音样本测 WER;测延迟与吞吐。

- 用户行为数据:如果能拿到竞品的 UA/保留率数据,可用第三方工具估算(App Annie、Sensor Tower 等),或者通过安装量、下载趋势做横向对比。

- 定性研究:App Store/应用市场评论挖掘、用户访谈、可用性测试、专家评审(语言学家/ROC+译者)。

- 技术探针:抓包分析接口、查看SDK、试用API限速和计费。

实操样例:构建测试语料

不要只用新闻或WMT数据,做“场景化”语料:

- 旅行:菜单、 метро 指示、问路短句

- 商务:合同条款、发票字段、产销对话

- 学习:短句、口语俚语、例句

- 拍照:不同光照、不同字体、复杂背景

如何打分并给出优先级

先确定权重(和团队目标挂钩),再对每个竞品打分。举个简单模板:

- 用户价值(0.35):包含场景覆盖度、易用性、性能体验

- 实现难度(0.25):工程成本、数据需求、合规负担

- 商业价值(0.25):ARPU、市场规模、付费潜力

- 战略匹配(0.15):品牌、渠道、长期可扩展性

每项打 1-5 分,乘权重求和,得分高的优先考虑复制/对标,低分的可能是补短板或者放弃。

具体要关注的KPIs与度量公式

- 活跃与留存:DAU/MAU、次日/7日/30日留存率

- 转化:新用户→付费用户转化率、免费试用转付费率

- 使用频率:每用户每日请求数、场景触发率(语音/拍照/文本占比)

- 质量指标:MT BLEU 或对话场景人工评分、ASR WER、OCR 识别率

- 性能:平均延迟(ms)、请求成功率、离线包大小

- 商业指标:ARPU、LTV、CAC、付费留存

用户研究:样本、问题与脚本

用户访谈别问太宽泛,带着具体场景去问。下面是示例脚本片段:

- 你上一次需要翻译时是什么情形?当时用的是哪个工具?

- 那个工具做得好/不好?举个具体例子。

- 在现场语音翻译时,你最怕什么?(延迟、噪音、误译)

- 你愿意为什么样的功能付费?(离线双向、专业领域术语、企业版)

样本规模:定性访谈 15-30 人覆盖不同用户画像;可用性测试 5-8 人/迭代。

性能与技术检测清单(工程角度)

- ASR 测试:在不同噪音、口音、语速下测 WER。

- MT 测试:用通用语料和领域语料分别测 BLEU + 人工评分。

- 端到端延迟:从用户说话到目标语言播放的平均与 95 百分位延迟。

- 离线能力:离线模型体积、内存占用、单次翻译耗电。

- 稳定性:并发场景下接口成功率、错误率、降级策略。

- 隐私合规:是否提供数据抹除、数据最小化、加密传输说明。

商业对标:定价模型与变现策略

主流模式

- 免费+流量内置广告:适配高频低付费场景

- 订阅制:月/年订阅,常见于高级语种、去广告、离线包

- 按次付费/API:面向企业或开发者,按字符/分钟计费

- 企业定制/白标:为企业客户提供术语库、接口 SLA、批量离线包

竞品分析时抓重点:各家价格区间、免费额度、API 计费规则、企业合约条款。

样例评分表(简化版)

| 项目 | 权重 | 易翻译 | 竞品A | 竞品B |

| 功能完备度 | 0.3 | 4 | 5 | 3 |

| 实时语音质量 | 0.25 | 3 | 4 | 2 |

| 离线能力 | 0.15 | 2 | 3 | 1 |

| 价格竞争力 | 0.15 | 3 | 2 | 4 |

| 合规/隐私 | 0.15 | 4 | 3 | 3 |

从分析到执行:如何把洞察变成产品动作

不要把竞品报告当成摆设,得转化成具体可做的事情:

- 短期(1-2 个月):修复关键痛点(例如降低关键场景下的ASR延迟,优化拍照OCR在低光下的鲁棒性)。

- 中期(3-6 个月):推出差异化功能(术语库、行业模板、多人对话模式或更友好的离线包)。

- 长期(6-12 个月):技术投入(自研模型/引擎替换)、渠道拓展(与旅行社、耳机厂商合作)与企业级产品化。

如何验证你的假设(A/B 与实验设计)

每个优先级项都应该有衡量成功的标准,例如:

- 目标:把语音翻译延迟从 800ms 降到 400ms → 成功标准:延迟降低且次日留存提高 5%。

- 目标:推出术语库订阅 → 成功标准:试用到付费转化率 ≥ 3%、ARPU 提升 10%。

竞争情报持续化:建立监控与反馈闭环

竞品分析不是一次性的。建议做法:

- 建立季度更新的竞品仓库(版本、功能变动、价格改动)

- App Store 评论关键词监控(爬取并做主题聚类)

- 定期复测核心指标(WER、BLEU、延迟)并记录到指标库

- 把用户洞察与产品计划每周/双周同步给执行团队

风险、合规与不可忽视的细节

技术细节会影响商业决策:

- 数据隐私:实时语音是否上传云端?是否需要用户授权与告知?

- 许可与模型来源:用第三方模型时要注意许可证(商用/非商用限制)。

- 本地化:进军不同国家要适配当地隐私、支付与内容监管。

- 重复投入风险:若多个功能都依赖同一模型,性能瓶颈会放大。

常见误区与避免方法(真实的,别被数据迷惑)

- 误区:只看下载量。下载量不等于活跃和付费,别被表面数字骗了。

- 误区:用单一自动化指标判定译文质量(BLEU 很好,但用户感知才是关键)。

- 误区:把所有功能都做足。说到底,先把一个场景做到极致更重要。

最后,给你几份可复制的产出模板

- 用户访谈模板(问题 + 记录栏 + 打分)

- 竞品评分表(可在表格里根据权重自动算总分)

- 性能测试脚本(ASR/WER 测试集、延迟测量流程)

- A/B 实验模板(假设、指标、样本量估算、判定阈值)

写到这里,有点像边干边想,不过这些步骤是我反复用过、也被团队验证过的流程。你可以先从最贵重的那几个问题入手(比如真实用户的痛点、以及一个能显著提升留存的技术改进),把竞品分析做成“能推动决策”的工具,而不是只是一堆漂亮的PPT。愿你把易翻译做成用户出门必备的那款工具,不停试错、快速学习、把证据留给未来。