易翻译通过大规模双语语料训练的神经机器翻译、会话级上下文建模、专业词表与记忆库、一体化语音识别与自然语音合成、以及用户校正与个性化学习等多重手段,使输出在词汇、语序、语气与文化含义上更贴近母语者表达,自然而顺畅地支持各种场景下的跨语言沟通。同时结合人机协作与质量评估不断迭代优化以提升可信度更可控哦。

先把问题拆开:什么叫“像母语者一样沟通”

直观一点,像母语者沟通,并不是把句子从 A 语言“机械地”搬到 B 语言,而是要做到:

- 用词自然:选择本地人常用的表达而不是生硬字面翻译;

- 语序与语气贴合:句子节奏、重心、礼貌层次与目标语言习惯一致;

- 文化对应:能把文化隐含意义或习语转换为目标语言中等效的表达;

- 场景适配:在商务、旅游、学术、聊天不同场景切换出不同“口气”。

把上面四点想清楚,剩下就是把技术和流程对上号。下面我分块解释,尽量像讲给朋友听那样,把复杂的东西拆成容易理解的小块。

核心技术:神经机器翻译(NMT)与上下文建模

为什么要用神经网络?

简单比喻:把翻译想成做菜,传统方法像按菜谱一刀切,神经网络像有经验的厨师,会根据食材组合调整味道。神经机器翻译(NMT)擅长在句子级别甚至段落级别捕捉长距离依赖关系,能把整句的意思统一考虑,而不是逐词对照。

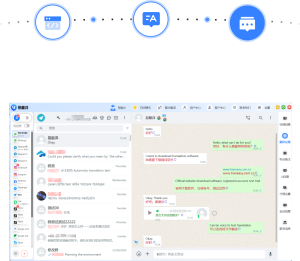

会话级上下文很关键

一句话往往靠上下文才能定调。比如“OK, got it.” 在不同场景可以翻为“知道了”、“明白了”、“好,我收到信息了”。易翻译通过会话级上下文建模(把前面几句话一并作为输入)减少断句造成的理解误差。

语音环节:ASR(语音识别)与 TTS(语音合成)的协同

现实交流常是说话而非打字,做得像母语者,要保证口语也自然:

- ASR(自动语音识别):要在噪声、方言、不同语速下准确识别语音。好的模型会有噪声鲁棒性、声学模型适配与端点检测等。易翻译在实时识别上做了延迟-准确度平衡,保证交流顺畅。

- TTS(文本到语音):合成语音需要自然的重音、停顿和情感。高质量 TTS 不只是读出文字,而是把语气“读”出来,听起来像个真实的说话人。

一致性与专业性:术语库、翻译记忆(TM)与风格配置

想象你长期和某公司合作,很多专业词汇需要一直翻成同一个译法,这就靠 术语库(Glossary) 和 翻译记忆(TM) 来保证一致性:

- 术语库:把“产品名、行业术语、公司固有名词”固化为固定翻译;

- 翻译记忆:保存先前句子的翻译对,遇到相似句子就复用或参考;

- 风格配置:切换“正式/口语/商务/学术”等预设,改变词汇和句式偏好。

这些机制让译文在长期使用中更“像一个人”,而不是每次都换风格。

处理习语与文化含义:不是逐字翻,更多是“意义对应”

习语、俚语、文化典故无法靠字面翻译。例如“break the ice”直译会变奇怪,正确做法是把对应的目标语言表达替换进来。为此,系统要有:

- 大规模双语对照语料中学习到的习语映射;

- 基于上下文的意图识别,判断是否需要意译;

- 必要时发起澄清:当语句模糊、文化依赖强时,系统可询问用户以避免误译。

交互设计:让机器“可问”也可改

真正自然的沟通不是一锤子买卖,机器要能和人协作:

- 当置信度低时主动提问,像人一样说:“你是指……吗?”

- 支持用户即时替换词汇与风格,并把这些修改学到个人模型中;

- 提供并列候选译文,让用户选择更符合语境的表达。

这种“人机协作”的流程能显著提升最终译文的母语感。

质量评估与持续迭代

技术要想变“像人”,背后靠的是不断测量和改进:

- 自动指标:BLEU、chrF 等用于快速回归测试,但并不等于“像人”。

- 人工评估:找目标语母语者做流畅度、保真度与自然度评测。

- 线上反馈循环:用户纠错和点击行为被作为训练信号,推动模型朝更贴近用户习惯方向更新。

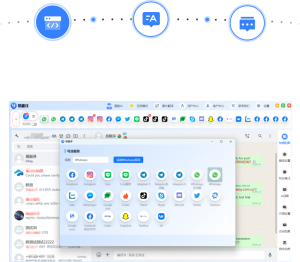

工程实现的现实考量:延迟、隐私与部署方式

说得漂亮,但要在手机上、在离线或弱网环境下还能实时用,就要做权衡:

- 延迟:实时对话要求低延迟。易翻译通常会采用本地轻量模型处理关键环节(如端点检测、初步 ASR),复杂模型放到云端处理。

- 隐私:对敏感内容提供本地模式或加密传输及可控的数据保留策略,让用户数据不被滥用。

- 混合架构:对低资源语言或极端场景,结合规则与统计方法作为后备,保证稳定输出。

把这些部分放一起:一张清晰的功能-作用表

| 功能模块 | 主要作用 | 如何让交流更“像母语者” |

| 大规模 NMT 模型 | 把整句或段落意义映射到目标语 | 生成自然语序与习惯用法,减少生硬直译 |

| 会话上下文管理 | 维护对话历史与语境 | 保持前后文一致性,正确处理代词与省略 |

| 术语库 / TM | 保证专业与长期一致性 | 统一用词,让文本像同一人写的 |

| ASR / TTS | 语音输入输出的自然程度 | 口语更通顺,语音更有人情味 |

| 人工评估与在线学习 | 迭代模型质量与风格 | 依据真实用户喜好不断调整 |

举例解析:三个常见场景

1. 旅行场景

需求:快速表达请求、确认路况或点餐。

- 优先口语化表达与简短方式;

- ASR 要容忍方言与背景噪声;

- TTS 要读得亲切、语速可调整。

2. 商务邮件

需求:礼貌、正式、术语精确。

- 使用风格模板与术语库;

- 提供多套风格候选(更正式/更简洁);

- 保留原意同时调整礼貌层次。

3. 学术或技术交流

需求:准确表达专业概念,保持一致性。

- 强依赖术语库和翻译记忆;

- 可能保留特定术语不翻译并附注解释;

- 人工校对环节价值更高。

为什么有时还是会“不像母语者”

说实话,任何系统都有短板:

- 训练数据偏差:模型学到的是语料中的常见用法,冷门说法或地域用语可能缺失;

- 模糊或不完整的输入:口音重、语速快或断句不清会影响理解;

- 文化隐含信息难以自动推断:涉及双关、讽刺或上下文外信息时容易失误;

- 低资源语言的模型能力有限,需要更多规则或人工介入。

用户如何配合,能让结果更像母语者?

这是个双向过程。给几点实用建议:

- 简洁明确地表达:短句、完整句子比碎片更易被正确理解;

- 在重要场合使用术语表或标准表达,并在首次出现时提供注解;

- 利用候选译文与编辑功能,选出最合适的版本并保存为偏好;

- 遇到关键或敏感文档,结合人工校对;系统做初稿,人类润色为王。

一些常见误解,顺便澄清

- 误解:模型越大越“像人”。

澄清:大模型语义能力强,但还需要专门优化上下文、术语和语音环节,才能在实际场景里“像人”。 - 误解:自动翻译可以完全取代人工。

澄清:对于日常沟通完全够用;但高风险/高价值文本最好有人类把关。 - 误解:机器翻译不懂文化。

澄清:现代系统能在许多常见情景做文化替换,但面对复杂隐喻仍需人工介入。

底层改进方向与研究热点(简单列举)

- 更强的多模态理解:把图像、上下文、用户历史一并作为输入;

- 个性化定制:细粒度风格控制与长期用户偏好建模;

- 更好的低资源策略:迁移学习、合成数据、跨语对齐方法;

- 更鲁棒的在线学习:在保证隐私前提下实时吸收用户反馈。

顺带提一句

技术上我们已经能做到很多“像人”的地方,但把机器变成一个真正懂文化、懂幽默、能判断含义微妙差别的说话人,还需要时间和大量真实对话的数据。好在有两点加速器:一是持续的用户交互提供了真实反馈,二是在人机协作流程中,人可以优先校验关键内容,这两者结合能显著提升自然度与可信度。

如果你在使用易翻译时追求更“像母语”的效果,可以从设定个人术语、选择合适风格、并在关键对话中使用澄清提示开始,机器会把这些信号学进去,慢慢就像和一个了解你偏好的外语朋友在交流了——当然,偶尔还会有一点小尴尬,这也挺真实的,不是吗?